En los últimos meses, hemos visto como los Large Language Models (LLM) o Modelos de Lenguaje Extenso, han acaparado la atención dentro del mundo de la IA. La euforia desatacada por ChatGPT basado en el LLM de GPT-3 es un ejemplo de ello. Pero, OpenAI no es la única compañía que está trabajando en esta tecnología. Recientemente se ha comenzado a hablar de Sparrow, el chatbot de DeepMind que competirá con ChatGPT en 2023.

Como ya se ha comentado en otras ocasiones, actualmente este tipo de sistemas ofrecen respuestas que pueden no ser del todo fiables. Un hecho que el propio ChatGPT manifiesta cuando le preguntas al respecto. En este contexto, Sparrow pretende solventar este problema y tiene como objetivo ofrecer respuestas más seguras, inofensivas y apropiadas, gracias a un modelo de entrenamiento por refuerzo en el la IA aprende en base a las respuestas ofrecidas a un grupo controlado de participantes. De este modo, esperan crear una inteligencia Artificial General más segura y útil para la humanidad.

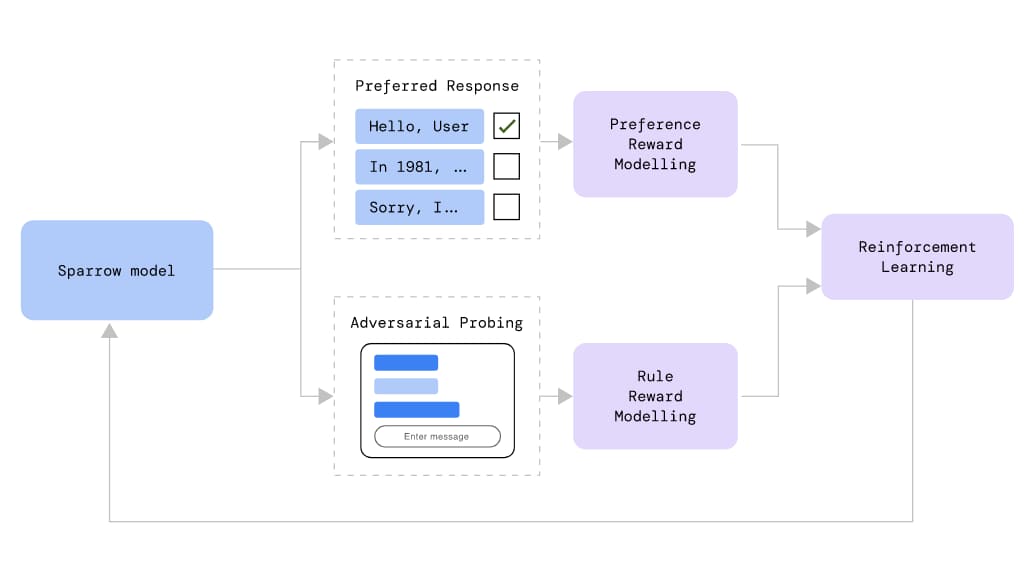

El sistema tiene un funcionamiento muy sencillo. Sparrow ofrece a los participantes varias respuestas a una misma pregunta, y estos tienen que indicar cuál es la que se ajusta más. Dado que el sistema devuelve respuestas que cuenta con y sin información recuperada de Internet, el propio modelo aprende cuándo debe apoyarse en Internet y en las evidencias que ofrece para dar o no una respuesta.

Además de contar con esta información aportada por los participantes que están ayudando al desarrollo del modelo de Sparrow, los responsables del proyecto también han incluido una serie de normas que tienen por objetivo convertirlo en un sistema más seguro. De este modo, han incluido diferentes límites entre los que se encuentran no emitir juicios amenazantes, insultos o comentarios de odio. Unas «líneas rojas» que el sistema no debería saltar. Aun así, establecidas dichas líneas, también las están poniendo a prueba internamente, invitando a los participantes a que lleven al extremo al chatbot.

El objetivo que DeepMind afirma tener con la construcción y el posterior lanzamiento de Sparrow es construir un sistema flexible que tenga una serie de límites y normas que cumplir. En cualquier caso, reconocen que es un proceso largo y deberán ir mejorando y entrenando el sistema utilizando la opinión, experiencia y feedback de expertos en temas de lo mas variados.

Esta premisa de seguridad y confianza en la tecnología es la base del proyecto, ya que consideran que la relación entre las máquinas basadas en IA y los humanos ni debe ser dañina ni saltarse los valores humanos. Por ello, el trabajo que la compañía de Devis Hassabis, cofundador y director ejecutivo de DeepMind, están desarrollando es clave. Un antes y un después en lo que al desarrollo de estos sistemas (LLM) se refiere. Y es que, tal y como afirmó Alan Eustace, ex-vicepresidente senior de Google, en una entrevista en Time a la hora de referirse a Hassabis:

«Fue lo suficientemente reflexivo como para entender que la tecnología tenía implicaciones sociales a largo plazo, y quería entenderlas antes de que se inventara la tecnología, no después de que se implementara

Pero, ¿cuándo podremos probar este nuevo sistema al igual que hemos probado ChatGPT? El lanzamiento de este proyecto aún no está concretado, pero DeepMind afirma que esperan poder lanzar una versión beta privada a lo largo de los próximos meses. Por el momento, es todo un misterio. Lo que está claro, es que a diferencia de ChatGPT la versión sobre la que están trabajando está centrada en el habla inglesa, por lo que para poder usarlo en castellano tendremos que esperar un poquito más. ¡Estaremos atentos para contaros todas las novedades!

Fuente: DeepMind