La Inteligencia Artificial está realizando cambios y potenciando muchas actividades profesionales. Algunos casos ya son conocidos, como el procesamiento del big data para evaluar el funcionamiento de productos digitales, la identificación de tipos de cáncer o la conducción de automóviles autónomos.

Creo que la Comunicación tal cual la conocemos (y la estudiamos) es una disciplina que todavía debe investigar para encontrar su lugar en esta nueva era y así beneficiarse de las técnicas digitales de procesamiento de información. No se trata de reinventar la rueda, pero sí de ver qué herramientas del universo de la Inteligencia Artificial y del Machine Learning pueden ser útiles al terreno comunicacional. Para lograr aquel objetivo es necesario experimentar, buscar, innovar.

Éste es el espíritu del siguiente artículo, que relata el uso experimental que realicé con Vision AI, la herramienta de Computer Vision de Google aplicada para el análisis de la Comunicación y la Oratoria Política.

Tabla de contenidos

¿Qué es Computer Vision?

La disciplina Computer Vision o Visión Artificial es una subrama de Machine Learning a través de la cual las computadoras aprenden a identificar imágenes. En simples términos, Computer Vision funciona a través de la transformación de los píxeles de las imágenes en números, a fin de que esos datos puedan ser entendidos por las computadoras.

De alguna manera la Visión Artificial intenta imitar el procedimiento por el cual los humanos miramos e identificamos los objetos que nos rodean para poder tomar decisiones e interactuar sobre ellos. Las principales empresas digitales como Google, Microsoft, IBM o Amazon ofrecen sus servicios de Computer Vision en la nube y compiten entre ellas en el mercado.

Comunicación política y oratoria

Una de las ramas de la comunicación, quizá la más antigua, es la oratoria. Es una disciplina a través de la cual las personas utilizan recursos retóricos y entrenan técnicas tanto de comunicación verbal como no verbal para persuadir a una audiencia.

En la oratoria y en la expresión oral es importante tanto el mensaje que se emite (por ejemplo, el texto de un discurso) así como la manera en que se lo comunica (lo “paratextual” o la comunicación no verbal). Ambos son elementos fundamentales para cautivar al público.

Ser un buen orador no es sólo “hablar correctamente”; sino que, a la manera de un actor, significa poder dominar elementos de la comunicación no verbal como el tono de voz, los gestos o las expresiones faciales. Claro que el control de aquellos factores (que muchas veces “se disparan” de manera involuntaria) debe estar supeditado a un objetivo de comunicación, previamente reflexionado y establecido.

En la oratoria política también el control de la comunicación no verbal es tan importante como el contenido del mensaje. Es por eso que las escuelas de oratoria y retórica ponen énfasis en reconocer aquellas expresiones involuntarias que, durante el acto de comunicación, pueden emerger y ser contradictorias con el mensaje emitido (por ejemplo, comunicar la decisión de recortar el gasto público con expresión dubitativa podría no resultar agradable ni efectiva).

Computer Vision y oratoria: análisis de un caso

Tradicionalmente el análisis de las expresiones no verbales ha sido realizado de forma analógica, mediante observadores humanos. Sin embargo, creo que hoy podría beneficiarse de la Computer Vision como una opinión alternativa en una evaluación de expresión oral. ¿De qué manera?

En agosto de 2020 se me encomendó hacer un análisis de comunicación no verbal de la exposición anual que realiza el Jefe de Gabinete del Gobierno de la Ciudad de Buenos Aires ante la Legislatura. Como en muchas otras oportunidades, la exposición fue televisada tanto por el canal de televisión del gobierno porteño como por las redes sociales (YouTube).

En principio, el análisis encarado tuvo el foco puesto en la observación de gestos faciales y corporales, en el tono de voz y en la proxémica (objetos y construcción del espacio). Además, se hizo una comparación entre aquellos elementos no verbales y el contenido textual del mensaje a fin de encontrar coincidencias o inconsistencias durante la exposición.

¿Cuándo entró Computer Vision en escena? De manera experimental, a las conclusiones observadas acerca de los gestos faciales, se le sumó un análisis complementario a través de Vision AI, la plataforma de Computer Visión de Google Cloud.

Es que como explica el sitio de Google Cloud, la herramienta Vision AI puede ser utilizada para comprender imágenes con una buena precisión predictiva; entrenar modelos de aprendizaje automático que clasifiquen imágenes según sus etiquetas personalizadas; y detectar objetos y rostros, leer escritura a mano, entre otras funciones.

La herramienta utiliza Machine Learning para analizar imágenes y reconocer objetos (en la siguiente foto reconoce personas, edificios y bicicletas), lugares de una ciudad, metadata de geolocalización de la imagen, propiedades y el tipo de contenido. Además, con respecto a los rostros, emite un informe de probabilidad sobre el sentido de la expresión facial (alegría, miedo, enojo, sorpresa, entre otros).

La posibilidad de detectar rostros, así como el sentido de las expresiones faciales a través de Machine Learning fue lo que impulsó la experimentación en este caso de oratoria política. Además, fue clave para esta ocasión experimental el acceso gratuito que provee la API de Vision AI.

Interpretando muletillas faciales

Durante la experiencia, la utilización de Computer Vision permitió interpretar algunas expresiones de la gesticulación facial. Por ejemplo, durante la exposición se detectó una “muletilla” reiterada, una “apertura de los ojos” y “levantamiento de cejas” que el orador repetía en algunos pasajes de la disertación. ¿Qué significaban esas expresiones?

Si bien toda muletilla surge durante algún momento de tensión, como forma de descarga, el sentido que los receptores hagan de aquella puede ser variado. Es aquí donde el análisis de Computer Vision puede proveer una interpretación alternativa.

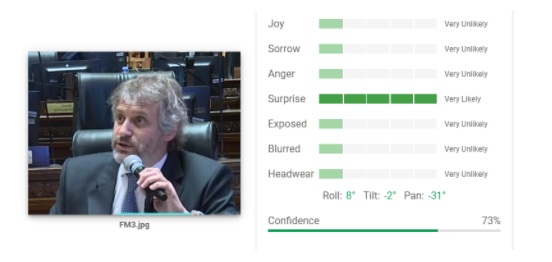

A fin de tener una opinión desde la Inteligencia Artificial, se capturaron una serie de imágenes del video y se las introdujo en la API de Vision AI/Google Cloud. Vision AI interpretó un sentimiento de sorpresa en aquella muletilla facial.

Tener presente la evaluación de Computer Vision permitió asignarle un sentido complementario a las interpretaciones humanas.

Conclusiones

Creo que los resultados de la experimentación expuesta entre Computer Vision y Oratoria Política fueron modestos. En definitiva, no ofrecieron conclusiones superadoras al análisis que realiza la observación humana.

Sin embargo, considero que esta combinación (Computer Vision, Machine Learning y Oratoria) tiene muchísimo potencial.

La experiencia podría escalar realizando un análisis del video en vivo (y no a través de capturas de pantalla). El estudio de una filmación completa podría emitir un informe estadístico de las expresiones más utilizadas durante la exposición. Este sería un insumo clave para encarar una posterior estrategia de entrenamiento del orador.

Además, y esto es muy valioso, la implementación más robusta de esta herramienta permitiría una mirada objetiva de un proceso atravesado por las emociones y tensiones como es el de la comunicación política.

Por supuesto, como sucede con otras aplicaciones de Machine Learning, no creo que la aplicación de Computer Vision en el análisis de la oratoria suplante a los observadores humanos. Pero también creo que puede convertirse en un fuerte aliado para brindar segundas opiniones que refuercen o permitan replantear el análisis.

En la medida que estas herramientas de Machine Learning y técnicas de Computer Vision se vuelvan más accesibles, los profesionales de la Comunicación se verán ante nuevos desafíos no solo para hacer una relectura de sus prácticas e incumbencias, sino también para inspirar la elaboración de nuevas estrategias de análisis.