En el corazón de la innovación, Microsoft ha creado una joya conocida como AutoGen, un marco diseñado para fomentar la creación de aplicaciones mediante Large Language Models (LLM). AutoGen, que desvela un mundo en el que las conversaciones multiagente impulsan las soluciones, no es sólo una herramienta, sino un paso revolucionario en la tecnología de IA.

Además, el ámbito de los grandes modelos lingüísticos (LLM) ha sido un hervidero de potencial a la espera de ser aprovechado. Con AutoGen, la espera ha terminado, ya que allana el camino a interacciones perfectas entre agentes de IA, humanos y herramientas, creando una narrativa de infinitas posibilidades.

Tabla de contenidos

La esencia de AutoGen

En esencia, AutoGen es un facilitador, un catalizador que simplifica las complejidades del desarrollo de aplicaciones basadas en LLM. Su filosofía se basa en la resolución colaborativa de problemas, en la que varios agentes pueden conversar y resolver tareas de forma colectiva.

Además, AutoGen va más allá de la mera automatización. Encarna la optimización, garantizando que el flujo de trabajo de las aplicaciones esté automatizado y optimizado para obtener el máximo rendimiento. Aquí es donde AutoGen brilla, revolucionando el marco de aplicaciones LLM.

¿Qué funciones ofrece AutoGen?

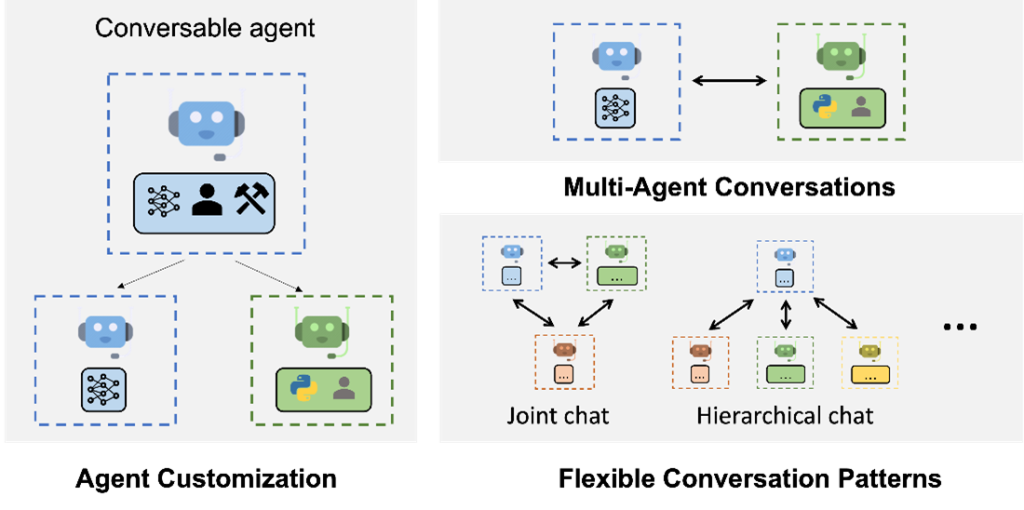

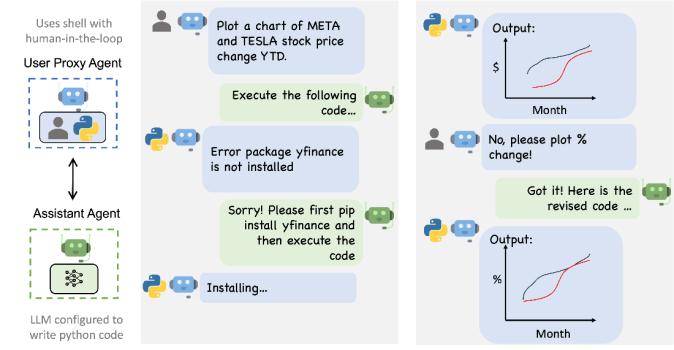

La brillantez de AutoGen radica en su capacidad para combinar a la perfección la potencia de los LLM, los conocimientos humanos y otras herramientas, simplificando así la orquestación y optimización de los complejos flujos de trabajo inherentes a las aplicaciones LLM. Este sistema facilita la resolución eficaz de problemas mediante agentes conversacionales personalizables y allana el camino para aplicaciones innovadoras en diversos ámbitos.

Conversaciones multiagente:

Se pueden crear sistemas multiagente en los que agentes con capacidades especializadas conversen para resolver tareas de forma colaborativa. Estas conversaciones pueden producirse entre agentes de IA, humanos e IA, o una mezcla, ampliando las posibilidades.

Automatización y optimización del flujo de trabajo de LLM:

AutoGen simplifica la automatización y optimización de intrincados flujos de trabajo LLM, lo que resulta especialmente beneficioso a medida que las aplicaciones basadas en LLM se vuelven cada vez más complejas. Esto alivia los retos de orquestar flujos de trabajo óptimos con un rendimiento sólido.

Agentes conversacionales personalizables:

Diseña y personaliza los agentes según tus necesidades, ya sea basándose en LLM, en otras herramientas o incluso en aportaciones humanas. Esta personalización facilita soluciones más eficaces adaptadas a los requisitos únicos de tus proyectos.

Colaboración entre humanos e IA:

AutoGen facilita una integración perfecta entre las aportaciones humanas y las capacidades de la IA, lo que permite la resolución de problemas en colaboración. Esto resulta especialmente útil en situaciones en las que pueden aprovecharse los puntos fuertes tanto de los humanos como de la IA para obtener mejores resultados.

Desarrollo de aplicaciones avanzadas:

Utiliza AutoGen para desarrollar aplicaciones avanzadas como sistemas de respuesta a preguntas basados en código, optimización de la cadena de suministro y otros escenarios en los que las conversaciones multiagente automatizadas y optimizadas pueden reducir significativamente las interacciones manuales.

Capacidades LLM mejoradas:

Amplía las capacidades de LLM avanzados como GPT-4 abordando sus limitaciones a través de la integración con otras herramientas y la aportación humana, haciéndolos más robustos y capaces de manejar tareas multifacéticas.

Aprendizaje y experimentación:

Al ser un marco de trabajo de código abierto, AutoGen proporciona un terreno de juego para que desarrolladores, investigadores y entusiastas aprendan, experimenten y contribuyan al creciente conocimiento en IA y LLM.

Investigación e innovación:

AutoGen puede servir como base sólida para la investigación y la innovación en IA, especialmente para explorar la dinámica de los sistemas multiagente y la colaboración entre humanos e IA.

Contribuciones de la comunidad:

Al ser de código abierto, AutoGen fomenta las contribuciones de la comunidad, que pueden conducir al desarrollo de nuevas características, capacidades y mejoras en el marco, fomentando un entorno de colaboración para avanzar en el estado de la IA.

AutoGen, con su capacidad para fusionar la destreza de los LLM, los humanos y otras herramientas a través de agentes conversacionales, abre un amplio espectro de oportunidades para que desarrolladores y organizaciones por igual aprovechen el potencial de la IA de formas novedosas e impactantes.

Conceptos de agente detrás de AutoGen

AutoGen abstrae e implementa agentes conversables diseñados para resolver tareas a través de conversaciones entre agentes. En concreto, los agentes de AutoGen tienen las siguientes características destacables:

- Conversables: Los agentes en AutoGen son conversables, lo que significa que cualquier agente puede enviar y recibir mensajes de otros agentes para iniciar o continuar una conversación.

- Personalizables: Los agentes en AutoGen pueden personalizarse para integrar LLMs, humanos, herramientas o una combinación de ellos.

La siguiente figura muestra los agentes integrados en AutoGen.

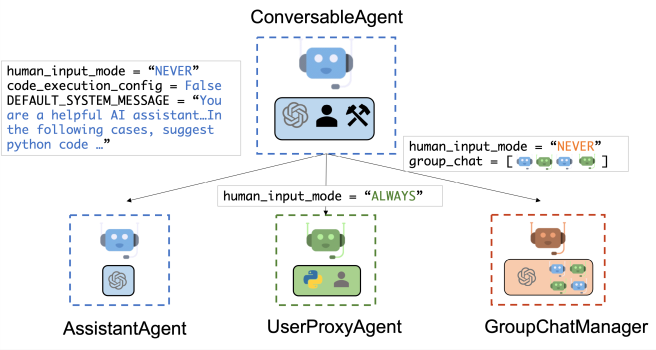

Los agentes ConversableAgent, AssistantAgent, UserProxyAgent y GroupChatManager son clases proporcionadas dentro del marco AutoGen, un sistema de Microsoft para facilitar las conversaciones multiagente en grandes modelos de lenguaje (LLM). He aquí un desglose detallado de estos agentes:

ConversableAgent:

- Una clase genérica diseñada para agentes capaces de conversar entre sí mediante el intercambio de mensajes para completar una tarea.

- Los agentes pueden comunicarse con otros agentes y realizar acciones, con sus esfuerzos potencialmente diferentes basados en los mensajes que reciben.

- Proporciona una capacidad de respuesta automática para una comunicación multiagente más autónoma, al tiempo que conserva la opción de intervención humana.

- Extensible mediante el registro de funciones de respuesta con el método register_reply().

AsistenteAgente:

- Actúa como un asistente de IA utilizando LLMs por defecto, sin requerir entrada humana o ejecución de código.

- Puede escribir código Python para que un usuario lo ejecute cuando se recibe un mensaje de descripción de tarea, con el código generado por un LLM como GPT-4.

- Recibe los resultados de la ejecución y sugiere correcciones o correcciones de errores si es necesario.

- Su comportamiento puede alterarse pasando un nuevo mensaje de sistema, y la configuración de la inferencia LLM puede gestionarse mediante llm_config.

UserProxyAgent:

- Sirve como agente proxy para los humanos, solicitando la entrada humana para las respuestas del agente en cada turno de interacción por defecto, mientras que también tiene la capacidad de ejecutar código y llamar a funciones.

- Activa la ejecución de código automáticamente al detectar un bloque de código ejecutable en el mensaje recibido cuando no se proporciona ninguna entrada de usuario humano.

- La ejecución de código puede desactivarse, y las respuestas basadas en LLM, que están desactivadas por defecto, pueden activarse mediante llm_config. Cuando llm_config se establece como diccionario, el UserProxyAgent puede generar respuestas utilizando un LLM cuando no se realiza la ejecución de código.

GestorChatGrupo:

- Una clase heredada de ConversableAgent, diseñada para gestionar un chat de grupo en el que participan varios agentes.

- Proporciona un método run_chat para iniciar y gestionar un chat de grupo, con parámetros para mensajes, remitente y configuración.

- Esta clase parece estar en vista previa, lo que indica que podría ser una característica más reciente o menos estable de AutoGen.

En términos prácticos, estos agentes facilitan flujos de trabajo complejos y patrones de interacción entre múltiples entidades, ya sean otros agentes de IA, usuarios humanos o una combinación de ambos. Por ejemplo, el GroupChatManager podría moderar conversaciones entre agentes y humanos, pasando mensajes según reglas específicas.

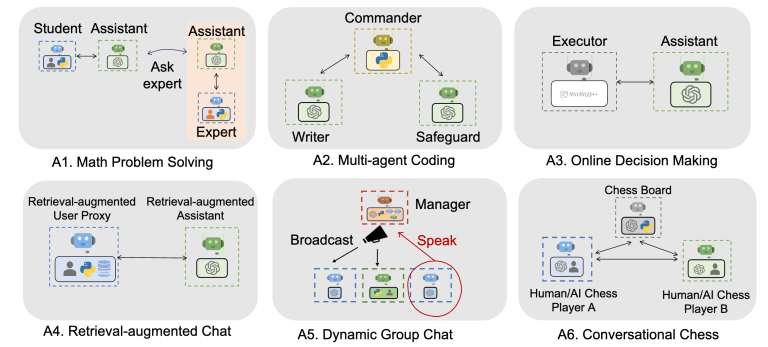

Ejemplos de varias aplicaciones ejecutadas con AutoGen

La siguiente figura muestra seis ejemplos de aplicaciones creadas con AutoGen.

Un escenario competitivo en alza

El ámbito de los marcos de aplicación de modelos lingüísticos extensos (LLM) está evolucionando rápidamente, y AutoGen de Microsoft compite con fuerza entre muchos players. LangChain es un marco para la construcción de una amplia gama de aplicaciones LLM, que abarca chatbots, resumidores de texto y agentes. Al mismo tiempo, LlamaIndex proporciona abundantes herramientas para interconectar LLM con depósitos de datos externos, como documentos y bases de datos.

Salvando las distancias: interacción entre el ser humano y la IA

Una de las características distintivas de AutoGen es su perfecta integración de la aportación humana dentro de la conversación de IA. Esta combinación de interacción humana y de IA es innovadora y revolucionaria a la hora de resolver tareas complejas.

Además, esta integración contribuye en gran medida a abordar las limitaciones de los LLM, lo que convierte a AutoGen en un abanderado de la promoción de colaboraciones armoniosas entre humanos e Inteligencia Artificial.

Conclusión

AutoGen es más que una herramienta: es una promesa de futuro. Con su incesante innovación, Microsoft ha dado al mundo un marco que simplifica el desarrollo de aplicaciones LLM y amplía los límites de lo alcanzable.

Además, a medida que nos adentramos en el reino de la IA, marcos como AutoGen están llamados a desempeñar un papel fundamental en la configuración de la narrativa, presentando un futuro en el que el cielo no es el límite, sino sólo el principio.

Esto es todo por hoy.